Формирование защищенных информационных процессов с применением искусственного интеллекта на корпоративном уровне

Олег Босенко, директор департамента кибербезопасности IBS

Олег Босенко, директор департамента кибербезопасности IBS Олег Босенко, директор департамента кибербезопасности IBSОтражаем подходы по защите от "галлюцинаций" ИИ, по контролю достоверности информации, по защите от дипфейков, общий подход к информационному процессу с ИИ, а также роль и место человека при реализации ИИ на корпоративном уровне.

Олег Босенко, директор департамента кибербезопасности IBSОтражаем подходы по защите от "галлюцинаций" ИИ, по контролю достоверности информации, по защите от дипфейков, общий подход к информационному процессу с ИИ, а также роль и место человека при реализации ИИ на корпоративном уровне.

Искусственный интеллект как технология активно вторгся как в жизнь общества, что подтверждается наличием большого числа доступных языковых моделей, так и в деятельность компаний и организаций, в том числе и в деятельность государственных органов.

При этом внедрение технологий и процессов на базе искусственного интеллекта справедливо рассматривается как шаг вперед в выстраивании информационных процессов. И несколько за кадром остается аспект, а что негативного, какие риски привносит или добавляет искусственный интеллект (далее ИИ) в информационные процессы, должна ли меняться защита этих процессов, и если да, то как.

Олег Босенко, директор департамента кибербезопасности IBS, в этой статье представит ответы на большую часть этих вопросов применительно к корпоративному уровню.

Зоны риска информационных процессов в случае применения ИИ

Психологически сложно представить, что внедрение передовой технологии может привести к увеличению рисков информационных процессов, но в случае с ИИ это обстоит именно так.

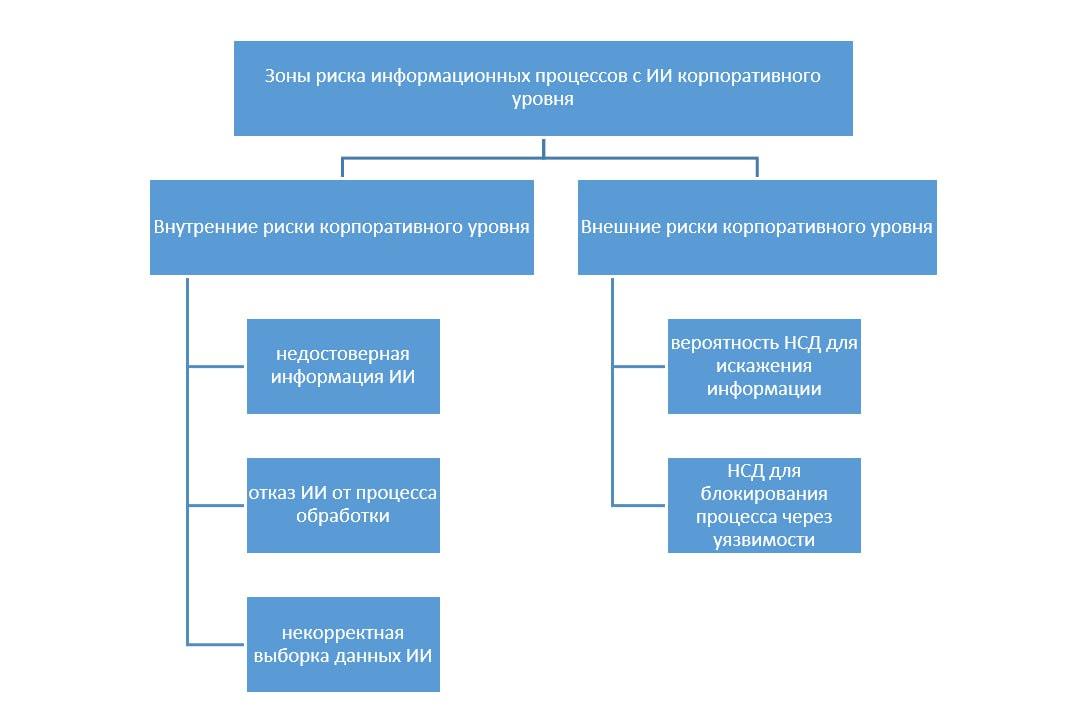

К зонам риска информационных процессов в результате применения ИИ на корпоративном уровне следует относить (рис. 1):

Содержательная часть внутренних рисков информационного процесса заключается в следующем:

- риск выработки ИИ недостоверной или искаженной результирующей информации в результате внутренних флуктуаций процесса обработки и недоработки алгоритмов функционирования;

- полный или частичный отказ ИИ от реализации информационного процесса в случае несоответствия запрашиваемых данных заложенному функционалу либо в результате сбоя защитных механизмов;

- некорректная выборка данных для обучения ИИ или для функционирования ИС, непроработка степени доверия к источникам информации.

Внешние риски информационных процессов лежат в плоскости несовершенства алгоритмов работы, наличия уязвимостей в программном обеспечении и, как результат этого, в возможности несанкционированного внешнего воздействия на информационный процесс с ИИ с целью искажения данных либо с целью блокирования самого процесса.

Блок-схема защищенного корпоративного информационного процесса с ИИ

Если задаться вопросом, а как должен выглядеть защищенный информационный процесс в эпоху ИИ, то ответ, который мы найдем, будет отличаться от обычного информационного процесса.

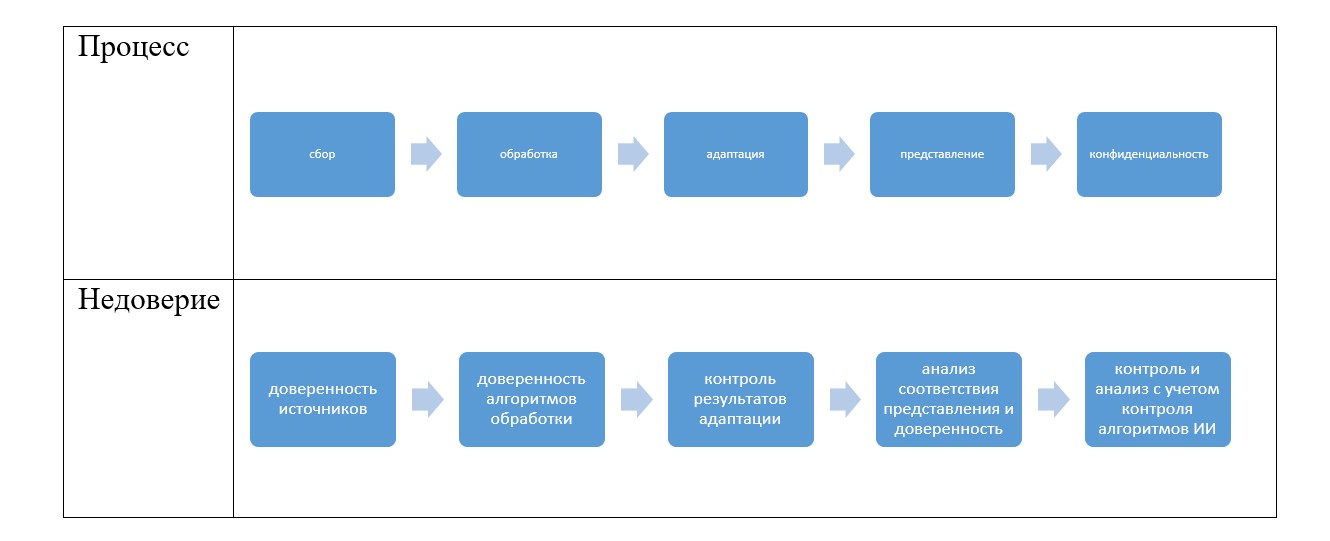

Для любого автоматизированного информационного процесса можно выделить следующие элементы:

- источники информации;

- процедура сбора информации;

- обработка информации;

- адаптация результатов обработки информации под запрос;

- представление результатов обработки информации;

- конфиденциальность процесса обработки.

Теперь определимся с различиями (табл.1)

Таблица. 1. Различия информационных процессов

|

Элементы информационного процесса |

Информационный процесс без ИИ |

Информационный процесс с ИИ |

|

Источники информации |

Четко определенные источники с заранее заложенными параметрами |

К заранее определенным источникам могут добавляться источники, "выбранные" ИИ. А для открытых языковых моделей ограничения в источниках нет |

|

Процедура сбора информации |

Строго фиксированный процесс по срокам и объемам |

Процесс допускает отклонения по срокам. По объемам процесс может варьироваться в зависимости от количества источников информации |

|

Обработка информации |

Последовательный алгоритмизированный процесс |

Алгоритмизированный процесс с аналитическими ответвлениями |

|

Адаптация результатов обработки под запрос |

Результат обработки жестко привязан к запросу |

Результат обработки, как правило, соответствует запросу. Но отличия от запроса могут присутствовать — "творчество" или "галлюцинации" ИИ |

|

Представление результатов обработки |

Типовые, изначально заложенные алгоритмы представления выходной информации |

Алгоритмы представления выходной информации допускают вариативность, "творчество ИИ" |

|

Конфиденциальность процесса обработки |

Процессы и средства отработаны и являются типизированными |

Существующих процессов и средств недостаточно. Необходима проработка доверия к процессам, в том числе в рамках конфиденциальности |

Как мы видим, информационный процесс с ИИ является менее стандартизированным и может привести к определенным отклонениям от реально требуемого результата.

Как же тогда должна выглядеть блок-схема защищенного информационного процесса с ИИ?

Базовым термином, позволяющим определить структуру такого процесса, является "недоверие". Это кажется странным, но единственно правильным в подходе к решению. В данном контексте недоверие следует понимать как необходимость сформировать математически обоснованный подход к оценке уровня доверия к составляющим информационного процесса с ИИ и, соответственно, к защищенности процесса. Вот как это будет выглядеть на блок-схеме (рис. 2). На информационный процесс накладываем составляющую "недоверия".

Специфика кибератак на информационные процессы с ИИ

Необходимо пояснить, почему мы говорим о доверии в рамках защищенного корпоративного информационного процесса с ИИ. Ответ на вопрос лежит в плоскости кибератак, вернее, в том изменении плоскости кибератак, которые как раз и связаны с наличием в информационном процессе ИИ. Вот как выглядит ситуация.

1. Атаки на входные данные. Злоумышленник изменяет входные данные или добавляет новые входные данные, чтобы повлиять на выводы или предсказания модели.

2. Атаки на обучение. Злоумышленник вносит в обучающую выборку неправильные или искаженные образцы, чтобы направить обучение модели по ложному сценарию.

3. Атаки на выводы модели. Злоумышленник пытается восстановить входные данные из модели, чтобы получить доступ к конфиденциальной информации.

4. Атаки на передачу информации. Злоумышленник пытается вывести информацию о модели, в том числе о ее архитектуре или параметрах обучения.

5. Атаки на выборку данных. Злоумышленник пытается влиять на выборку данных, используемых при обучении модели, чтобы нарушить ее обучение.

Следует обратить внимание, что на первый план выходят атака на информацию, в том числе исходную информацию, и атака на информационный процесс и его алгоритмизацию. Новую угрозу, которой ранее не было в привычном ИТ, представляют атаки на выводы модели и атаки на выборку данных.

Что делать и как строить

Несмотря на вышеуказанные риски, применение ИИ в корпоративных информационных процессах — это хорошее настоящее и перспективное будущее.

Для защищенности информационного процесса с ИИ следует предусматривать:

1. Разработку методологии оценки доверия составляющих корпоративного информационного процесса с ИИ. В том числе с применением процедур контроля безопасности разрабатываемого программного обеспечения для ИИ.

2. Обеспечение целостности, согласованности и аутентифицированности доступа к данным, которые применяются для обучения модели. Использование многофакторной аутентификации и IAM для контроля доступа к данным и ресурсам.

3. Предотвращение утечки конфиденциальной информации, выполнения несанкционированного кода, распространения дезинформации и компрометации систем и данных.

4. Создание гибкого и масштабируемого решения для управления данными и решения интеграционных задач.

5. Использование уникальной цифровой подписи для данных, которая позволяет убедиться, что они не были изменены или повреждены при хранении или передаче.

6. Автоматизация процессов интеграции и доставки моделей с использованием алгоритмов непрерывной интеграции и непрерывного развертывания для управления жизненным циклом моделей.

7. Соответствие требованиям законодательства в части общей защиты информации.

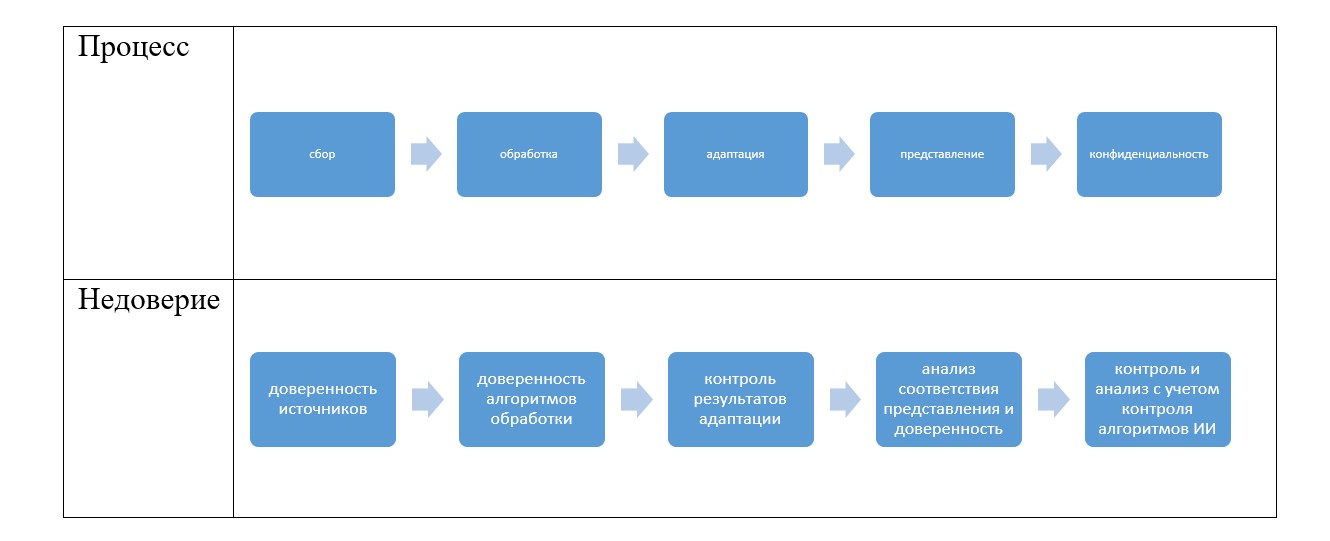

Не будет открытием сказать, что реализация этих подходов возможна только на базе этапности. В общем случае процесс построения включает в себя пять этапов (рис. 3).

Этап 1. Анализ и методология доверия. На этом этапе формируется корпоративный подход к оценке доверия источникам информации, самого процесса с ИИ. Анализируется существующая ситуация, а также проверяются в части безопасности предлагаемые решения для ИИ.

Этап 2. Оценка взаимовлияния обычных информационных процессов и процессов с ИИ. Информационные процессы с ИИ включаются в общий корпоративный ландшафт информационных процессов. Соответственно, они могут "унаследовать" все негативные моменты от обычных процессов либо привнести негатив в обычные процессы. Следовательно, необходимо отследить взаимосвязи и исключить негативное влияние.

Этап 3. Формирование модели угроз для ИИ. Учитывая характер угроз для ИИ, его постоянную динамику изменений, для формирования решения по защищенности необходимо полно и грамотно сформировать модель угроз. Следует учесть, что для ИИ формирование модели угроз должно в обязательном порядке включать как внешние, так и внутренние угрозы. В том числе и угрозы, порождаемые самим ИИ.

Этап 4. Техническое проектирование с учетом защищенности. В самом техническом проектировании нет каких-то больших особенностей. По существу, присутствует одна особенность – техническое решение по защищенности должно учитывать принятый подход к оценке доверия ИИ.

Этап 5. Внедрение и техническая поддержка. Этот этап можно считать классическим. Добавляется только необходимость периодического анализа информационного процесса с ИИ на отсутствие искажений и "галлюцинаций". Модель может прирастать компетенциями как в положительном, так и в отрицательном смысле. И технологический контроль становится обязательной процедурой, а не только по результатам инцидентов.